RAM価格の急騰:2025年には最大619%上昇

RAM価格がAI需要による供給圧力で163〜619%上昇

2025年後半にかけて、メモリ市場はかつてない価格のボラティリティに直面しています。すべてのセグメントにわたってRAMの価格が急騰しており、RAM価格の急騰が深刻な状況となっています。

RAM価格がAI需要による供給圧力で163〜619%上昇

2025年後半にかけて、メモリ市場はかつてない価格のボラティリティに直面しています。すべてのセグメントにわたってRAMの価格が急騰しており、RAM価格の急騰が深刻な状況となっています。

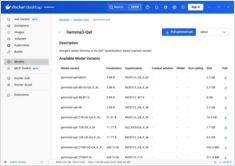

Compare the best local LLM hosting tools in 2026. API maturity, hardware support, tool calling, and real-world use cases.

LLMをローカルで実行することは、開発者、スタートアップ企業、さらには企業チームにとって現在実用的です。

しかし、正しいツールの選択 — Ollama、vLLM、LM Studio、LocalAI またはその他のツール — は、あなたの目的によって異なります:

Goマイクロサービスを使用して堅牢なAI/MLパイプラインを構築しましょう

AIおよび機械学習(ML)ワークロードがますます複雑になるにつれて、強固なオーケストレーションシステムの必要性が高まっています。Goのシンプルさ、パフォーマンス、並行処理能力は、MLパイプラインのオーケストレーションレイヤーを構築する際に理想的な選択肢です。モデル自体がPythonで書かれている場合でも、Goは理想的な選択肢です。https://www.glukhov.org/ja/post/2025/11/go-microservices-for-ai-ml-orchestration-patterns/ “Go in ML orchestration pipelines”。

テキスト、画像、音声を共有された埋め込み空間に統一する

クロスモーダル埋め込みは、人工知能において画期的な進展をもたらし、統一された表現空間内で異なるデータタイプ間の理解と推論を可能にします。

予算のハードウェアでオープンモデルを使用して企業向けAIを展開

AIの民主化はここにあります。 Llama 3、Mixtral、QwenなどのオープンソースLLMが、今やプロプライエタリモデルと同等の性能を発揮するようになり、チームは消費者ハードウェアを使用して強力なAIインフラストラクチャを構築できるようになりました。これにより、コストを削減しながらも、データプライバシーやデプロイメントに関する完全なコントロールを維持することが可能です。

LongRAG、Self-RAG、GraphRAG - 次世代の技術

リトリーバル・オーガナイズド・ジェネレーション (RAG) は単純なベクトル類似性検索を超えています。 LongRAG、Self-RAG、GraphRAGはこれらの能力の最先端を代表しています。

GGUF量子化でFLUX.1-devを高速化

FLUX.1-dev は、驚くほど美しい画像を生成できる強力なテキストから画像生成モデルですが、24GB以上のメモリが必要なため、多くのシステムでは実行が難しいです。 GGUF量化されたFLUX.1-dev は、メモリ使用量を約50%削減しながらも、優れた画像品質を維持するという解決策を提供します。

Docker Model Runnerでコンテキストサイズを設定する際の回避策

Docker Model Runnerにおけるコンテキストサイズの設定は、本来よりも複雑です。

テキスト指示を使って画像を拡張するためのAIモデル

ブラックフォレスト・ラボズは、FLUX.1-Kontext-devという高度な画像から画像へのAIモデルをリリースしました。このモデルは、テキストの指示を使って既存の画像を補強します。

NVIDIA CUDAをサポートしたDocker Model RunnerでGPU加速を有効にする

Docker Model Runner は、Dockerが公式に提供するローカルでAIモデルを実行するためのツールですが、

Docker Model RunnerにおけるNVidia GPUの加速の有効化 には特定の設定が必要です。

LLMのコストを80%削減するスマートなトークン最適化で

トークン最適化は、コスト効率の良いLLMアプリケーションから予算を圧迫する実験を分ける重要なスキルです。

ご自身でホストするAIを活用したバックアップに使用される写真

Immich は、あなたの思い出を完全にコントロールできる、革新的なオープンソースでセルフホスト型の写真および動画管理ソリューションです。Google Photos と競合する機能を備えており、AI による顔認識、スマート検索、自動モバイルバックアップを含みながら、あなたのデータをプライバシーとセキュリティを保ったまま、あなたのサーバー上に保管します。

GPT-OSS 120bの3つのAIプラットフォームにおけるベンチマーク

私は、Ollama上でGPT-OSS 120bのパフォーマンステストを3つの異なるプラットフォームで確認しました:NVIDIA DGX Spark, Mac Studio, and RTX 4080。OllamaライブラリのGPT-OSS 120bモデルは65GBあり、これはRTX 4080(または新しいRTX 5080の16GB VRAMには収まらないことを意味します。

Pythonの例を使ってAIアシスタント用のMCPサーバーを構築する

モデルコンテキストプロトコル(MCP)は、AIアシスタントが外部データソースやツールとどのように相互作用するかを革命的に変えてきました。本ガイドでは、ウェブ検索およびスクレイピング機能に焦点を当てた例を用いて、MCPサーバーをPythonで構築する方法について説明します。

Docker Model Runner コマンドのクイックリファレンス

Docker Model Runner (DMR) は、2025年4月に導入された Docker の公式ソリューションで、AIモデルをローカルで実行するためのものです。このチートシートでは、すべての必須コマンド、構成、およびベストプラクティスのクイックリファレンスを提供しています。

Docker Model RunnerとOllamaを比較してみる:ローカルLLM向け

ローカルで大規模言語モデル(LLM)を実行する は、プライバシー、コスト管理、オフライン機能のためにますます人気になってきています。 2025年4月にDockerが**Docker Model Runner (DMR)**を導入し、AIモデルの展開用の公式ソリューションとして登場したことで、状況は大きく変わりました。