Vane(Perplexica 2.0)Ollama と llama.cpp を使用したクイックスタート

ローカル LLM を活用したセルフホスティング AI 検索

Vane は、「出典付き AI 検索」領域において、より実用的な選択肢の一つです。これは、リアルタイムのウェブ取得とローカルまたはクラウド上の LLM(大規模言語モデル)を組み合わせた、セルフホスティング可能な回答エンジンであり、スタック全体をユーザーの管理下に置くことができます。

ローカル LLM を活用したセルフホスティング AI 検索

Vane は、「出典付き AI 検索」領域において、より実用的な選択肢の一つです。これは、リアルタイムのウェブ取得とローカルまたはクラウド上の LLM(大規模言語モデル)を組み合わせた、セルフホスティング可能な回答エンジンであり、スタック全体をユーザーの管理下に置くことができます。

公開ポートを使用しないリモート Ollama アクセス

Ollama は、ローカルデーモンとして扱われるときに最も快適に動作します。CLI とアプリケーションがループバック HTTP API と通信し、残りのネットワークにはその存在が知られない状態です。

GPU および永続性を備えた Compose ファーストの Ollama サーバー。

Ollama は、メタル(物理マシン)上で非常に良好に動作します。それをサービスとして扱うと、さらに興味深くなります。安定したエンドポイント、固定されたバージョン、永続的なストレージ、そして GPU が利用可能か不可かの明確な状態が確保されます。

ストリーミング応答を破綻させずに HTTPS で Ollama を利用する。

リバースプロキシの背後で Ollama を実行することは、HTTPS、オプションのアクセス制御、予測可能なストリーミング動作を実現する最も簡単な方法です。

RAG エンベッディング - Python、Ollama、OpenAI API。

検索拡張生成 (RAG) を実装されている方に向けて、このセクションではテキスト埋め込み(text embeddings)について平易な言葉で解説します。埋め込みとは何か、検索や検索(リトリバル)にどのように組み込まれるか、そしてOllamaやllama.cppベースのサーバーが提供するOpenAI 互換の HTTP API を使用して、Pythonから 2 つの一般的なローカル環境を呼び出す方法を説明します。

OpenCode LLM テスト — コーディングおよび精度の統計

Ollama と llama.cpp でローカルホストされている複数の LLM と、比較のために追加した OpenCode Zen の無料モデルとの組み合わせで、OpenCode がどのように動作するかをテストしました。

Ollama を使用して OpenClaw をローカルにインストールする

OpenClaw は、Ollama などのローカル LLM ランタイム、または Claude Sonnet などのクラウドベースモデルと連携して動作するように設計された、セルフホスト型の AI アシスタントです。

セルフホスト型LLMでデータとモデルを制御

LLM(大規模言語モデル)のセルフホスティングは、データ、モデル、推論をあなたの管理下に保つものであり、チーム、企業、国家にとって AI主権 を実現するための実用的な手段です。

RTX 4080(16GB VRAM)でのLLM速度テスト

大規模言語モデルをローカルで実行すると、プライバシーの確保、オフラインでの使用が可能になり、APIコストはゼロになります。このベンチマークでは、RTX 4080上で動作する14のポピュラーなLLMs on Ollamaから期待できる性能が明らかになります。

2026年1月の人気Goリポジトリ

Goエコシステムは、AIツール、セルフホストアプリケーション、開発者インフラにわたる革新的なプロジェクトとともに、ますます活気づいています。この概要では、今月のGitHub上位トレンドGoリポジトリについて分析します。

ローカルLLM用のセルフホスト型ChatGPT代替ソフトウェア

Open WebUI は、大規模言語モデルと対話するための強力で拡張性があり、機能豊富な自己ホスト型ウェブインターフェースです。

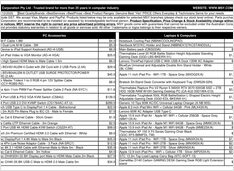

オーストラリアの小売業者から、リアルなオーストラリアドルでの価格を今すぐ。

NVIDIA DGX Spark (GB10 Grace Blackwell) は、主要な PC 小売店に国内在庫があり、オーストラリアで入手可能 となっています。 世界的な DGX Spark の価格と入手性 を追いかけていただいている方なら、オーストラリアでの価格帯はストレージ構成や小売店によって 6,249 オーストラリアドルから 7,999 オーストラリアドル であることが、ご関心をお持ちいただけるでしょう。

ローカルLLMを使用してCogneeをテストする - 実際の結果

CogneeはPythonフレームワークで、LLMを使用してドキュメントから知識グラフを構築します。 しかし、これはセルフホストされたモデルと互換性がありますか?

BAML と Instructor を使用した型安全な LLM 出力

LLM(大規模言語モデル)を本番環境で使用する際には、構造化された、型安全な出力を得ることが極めて重要です。

BAMLおよびInstructorという2つの人気のあるフレームワークは、この問題に対して異なるアプローチを取ります。