オーストラリアでGPUとRAMの価格が上昇:RTX 5090は15%、RAMは38%上昇 - 2026年1月

2025年1月GPUおよびRAM価格チェック

今日、トップレベルの消費者向けGPUとRAMモジュールについて見てみましょう。

特に注目しているのは、RTX-5080およびRTX-5090の価格と、32GB(2x16GB)DDR5 6000です。

2025年1月GPUおよびRAM価格チェック

今日、トップレベルの消費者向けGPUとRAMモジュールについて見てみましょう。

特に注目しているのは、RTX-5080およびRTX-5090の価格と、32GB(2x16GB)DDR5 6000です。

ローカルLLM用のセルフホスト型ChatGPT代替ソフト

Open WebUIは、拡張性が高く、機能豊富な自己ホスト型のウェブインターフェースで、大規模言語モデルとやり取りするのに最適です。

OpenAI API を使用した高速なLLM推論

vLLM は、UC BerkeleyのSky Computing Labが開発した、大規模言語モデル(LLM)向けの高スループットでメモリ効率の良い推論およびサービングエンジンです。

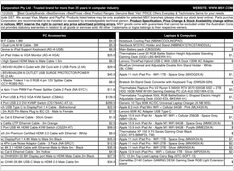

今やオーストラリアの小売業者から実際のAUD価格が提供されています。

NVIDIA DGX Spark (GB10 Grace Blackwell)は オーストラリアで今すぐ購入可能 の主要PC小売店で在庫あり。

グローバルDGX Sparkの価格と入手方法を ご存知の方は、オーストラリアの価格がストレージ構成や小売店によって 6,249〜7,999オーストラリアドル と幅があることをご存知でしょう。

ローカルLLMでCogneeをテストする - 実際の結果

CogneeはPythonフレームワークで、LLMを使用してドキュメントから知識グラフを構築するためのものです。 しかし、これは自社ホストされたモデルと互換性があるのでしょうか?

LLMを自社でホストするCogneeについての考察

最適なLLMの選定は、グラフ構築の品質、幻覚率、ハードウェアの制約をバランスよく考慮する必要があります。

Cogneeは、Ollama](https://www.glukhov.org/ja/post/2024/12/ollama-cheatsheet/ “Ollama cheatsheet”)を通じて32B以上の低幻覚モデルで優れたパフォーマンスを発揮しますが、軽量な構成では中規模のオプションも利用可能です。

PythonとOllamaを使ってAI検索エージェントを構築する

OllamaのPythonライブラリは、今やOLlama web searchのネイティブな機能を含んでいます。わずか数行のコードで、ローカルのLLMをインターネット上のリアルタイム情報を補完し、幻覚を減らし、正確性を向上させることができます。

RAGスタックに適したベクトルDBを選びましょう

正しいベクトルストアを選択することで、RAGアプリケーションの性能、コスト、拡張性が大きく左右されます。この包括的な比較では、2024年~2025年の最も人気のあるオプションをカバーしています。

GoとOllamaを使ってAI検索エージェントを構築する

OllamaのWeb検索APIは、ローカルLLMにリアルタイムのウェブ情報を補完する機能を提供します。このガイドでは、GoでのWeb検索の実装について、単純なAPI呼び出しからフル機能の検索エージェントまでの実装方法を示します。

RAM価格がAI需要による供給圧力で163〜619%上昇

2025年後半にかけて、メモリ市場はかつてない価格のボラティリティに直面しています。すべてのセグメントにわたってRAMの価格が急騰しており、RAM価格の急騰が深刻な状況となっています。

12種類以上のツールでローカルLLMの展開をマスターする

ローカルでのLLMの展開は、開発者や組織がプライバシーの向上、レイテンシーの低減、AIインフラストラクチャの制御の強化を求めるにつれて、ますます人気になっています。

AIに最適な消費者向けGPUの価格 - RTX 5080およびRTX 5090

トップレベルの消費者向けGPUの価格を比較してみましょう。特にLLM(大規模言語モデル)に適しており、AI全般にも適しています。具体的には以下を確認しています。

予算のハードウェアでオープンモデルを使用して企業向けAIを展開

AIの民主化はここにあります。 Llama 3、Mixtral、QwenなどのオープンソースLLMが、今やプロプライエタリモデルと同等の性能を発揮するようになり、チームは消費者ハードウェアを使用して強力なAIインフラストラクチャを構築できるようになりました。これにより、コストを削減しながらも、データプライバシーやデプロイメントに関する完全なコントロールを維持することが可能です。

プロメテウスで堅牢なインフラストラクチャのモニタリングを構築しましょう

Prometheus は、クラウドネイティブなアプリケーションとインフラストラクチャのモニタリングにおいて事実上の標準となり、メトリクスの収集、クエリ、可視化ツールとの統合を提供しています。

グラファナの設定をマスターしてモニタリングと可視化を実現しましょう

Grafana は、メトリクス、ログ、トレースを視覚的に表現し、アクション可能なインサイトに変換するための、監視および観測性のための主要なオープンソースプラットフォームです。

順序付きスケーリングと永続的なデータを使用してステートフルなアプリを展開する

Kubernetes StatefulSets は、安定したアイデンティティ、永続的なストレージ、および順序付きデプロイメントパターンを必要とするステートフルなアプリケーションを管理するための最適なソリューションです。データベース、分散システム、キャッシュレイヤーなどに不可欠です。