GNOME Boxes: 기능, 장점, 도전 과제 및 대안에 대한 종합 가이드

GNOME Boxes를 사용한 Linux용 간단한 가상 머신 관리

현대 컴퓨팅 환경에서 가상화는 개발, 테스트, 여러 운영 체제의 실행에 필수적인 요소가 되었습니다. Linux 사용자들이 가상 머신을 관리하는 데 간단하고 직관적인 방법을 원한다면, GNOME Boxes는 기능성을 희생하지 않고 사용 편의성을 중시하는 가벼운 사용자 친화적인 옵션으로 두드러집니다.

GNOME Boxes를 사용한 Linux용 간단한 가상 머신 관리

현대 컴퓨팅 환경에서 가상화는 개발, 테스트, 여러 운영 체제의 실행에 필수적인 요소가 되었습니다. Linux 사용자들이 가상 머신을 관리하는 데 간단하고 직관적인 방법을 원한다면, GNOME Boxes는 기능성을 희생하지 않고 사용 편의성을 중시하는 가벼운 사용자 친화적인 옵션으로 두드러집니다.

전문적인 칩이 AI 추론을 더 빠르고 저렴하게 만들어가고 있습니다.

가용성, 6개 국가의 실제 소매 가격, Mac Studio와의 비교.

**NVIDIA DGX Spark**는 실제 제품이며, 2025년 10월 15일에 판매가 시작되며, CUDA 개발자들이 로컬 LLM 작업을 수행하기 위해 통합된 NVIDIA AI 스택이 포함된 제품을 대상으로 합니다. 미국 MSRP는 $3,999이며, 영국/독일/일본의 경우 VAT 및 채널 비용으로 인해 가격이 더 높습니다. AUD/KRW 공식 가격표는 아직 널리 공개되지 않았습니다.

AI에 적합한 소비자용 GPU 가격 - RTX 5080 및 RTX 5090

다시 한 번, LLM(대규모 언어 모델)에 특히 적합하고 AI 전반에 일반적으로 적합한 최상위 소비자용 GPU의 가격을 비교해 보겠습니다.

구체적으로 저는

RTX-5080 및 RTX-5090 가격

을 살펴보고 있습니다. 가격이 약간 하락했습니다.

GPU 부하 모니터링을 위한 애플리케이션 목록

GPU 로드 모니터링 애플리케이션: nvidia-smi vs nvtop vs nvitop vs KDE plasma systemmonitor.

2025년 7월에 곧 제공될 예정입니다.

NVIDIA는 곧 NVIDIA DGX Spark를 출시할 예정입니다. 이는 Blackwell 아키텍처를 기반으로 한 소형 AI 슈퍼컴퓨터로, 128GB 이상의 통합 RAM과 1 PFLOPS의 AI 성능을 제공합니다. LLM을 실행하는 데 매우 적합한 장비입니다.

AI에 적합한 GPU 가격 업데이트 - RTX 5080 및 RTX 5090

최상위 소비자용 GPU의 가격을 비교해 보겠습니다. 특히 LLM(대규모 언어 모델)에 적합하지만, 일반적으로 AI에도 적합한 GPU에 초점을 맞추겠습니다.

구체적으로는 다음을 확인해 보세요:

RTX 5080 및 RTX 5090 가격. 가격이 약간 하락했습니다.

가격 현실 провер - RTX 5080 및 RTX 5090

3개월 전만 해도 RTX 5090은 가게에서 보이지 않았지만, 지금은 이미 판매되고 있지만 가격은 MRSP보다 약간 높은 편입니다.

가장 저렴한 호주에서의 RTX 5080 및 RTX 5090 가격을 비교해 보고 어떻게 되는지 확인해 보겠습니다.

더 많은 RAM, 더 적은 전력 소비, 여전히 비싸다...

최고의 자동화 시스템으로 어떤 멋진 일도 수행할 수 있습니다.

LLM용으로 두 번째 GPU를 설치할 생각이신가요?

PCIe 랜의 수가 LLM 성능에 미치는 영향? 작업에 따라 다릅니다. 훈련 및 멀티 GPU 추론의 경우 성능 저하가 상당합니다.

그리고 왜 내가 이 BSOD를 계속 보고 있는 건가...

이 문제로 인해 큰 충격을 받았습니다. 하지만 BSOD가 제게와 비슷한 경우라면, 자신의 PC를 조사하고 테스트해 보는 것이 좋습니다. 원인은 인텔 13세대 및 14세대 CPU의 성능 저하 문제입니다.

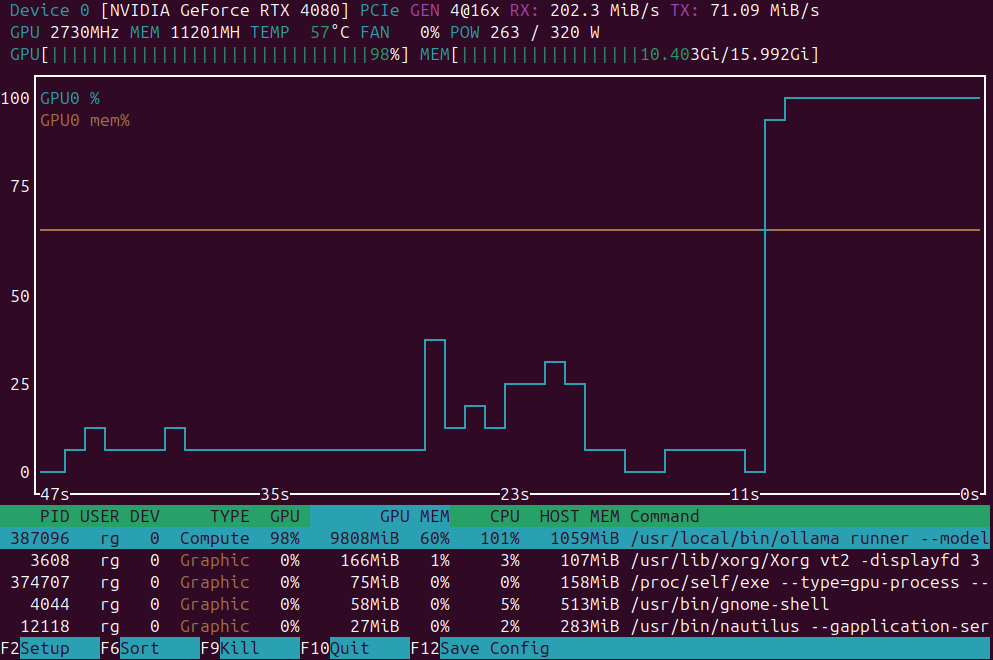

인텔 CPU의 효율성 코어 vs 성능 코어에서의 Ollama

제가 테스트하고 싶은 이론은, 인텔 CPU에서 모든 코어를 사용하면 LLM의 속도가 빨라질까?입니다.

새로운 gemma3 27비트 모델(gemma3:27b, ollama에서 17GB)이 제 GPU의 16GB VRAM에 맞지 않아, 부분적으로 CPU에서 실행되고 있다는 점이 제게 짜증을 주고 있습니다.

AI는 많은 컴퓨팅 파워가 필요합니다...

현대 세계의 혼란 속에서 저는 다른 카드의 기술 사양 비교를 진행하고 있습니다. 이는 AI 작업에 적합한 카드들입니다.

(딥러닝,

객체 감지,

LLMs).

하지만 이 모든 카드는 매우 비싸죠.

병렬 요청 실행을 위해 ollama 구성하기.

Ollama 서버가 동일한 시간에 두 개의 요청을 받을 경우, 그 동작은 구성 설정과 사용 가능한 시스템 자원에 따라 달라집니다.

기존 프린터 드라이버와 비교해 훨씬 간단합니다.

ET-8500을 Windows에 설치하는 방법은 매뉴얼에 잘 설명되어 있습니다. ET-8500 Linux 드라이버 설치는 간단하지만 복잡한 부분도 있습니다. 이 가이드는 우리의 2026년 문서화 도구: Markdown, LaTeX, PDF 및 인쇄 워크플로우 허브의 일부입니다.

GPU 대 CPU에서 LLM의 속도를 테스트해 보겠습니다.

다양한 버전의 LLM(llama3, phi3, gemma, mistral)의 예측 속도를 CPU와 GPU에서 비교합니다.