Ollama 에서 지원하는 Qwen3 임베딩 및 리랭커 모델: 최첨단 성능

Ollama 에서 제공되는 새로운 놀라운 LLM 들

Qwen3 임베딩 및 리랭커 모델 은 Qwen 시리즈의 최신 릴리스로, 고급 텍스트 임베딩, 검색 및 재랭킹 작업을 위해 특별히 설계되었습니다.

Ollama 에서 제공되는 새로운 놀라운 LLM 들

Qwen3 임베딩 및 리랭커 모델 은 Qwen 시리즈의 최신 릴리스로, 고급 텍스트 임베딩, 검색 및 재랭킹 작업을 위해 특별히 설계되었습니다.

모든 페이지 관련 콘텐츠를 하나의 폴더에 보관하는 중...

조금 오랜 시간 동안 저는 페이지의 썸네일 이미지를 정적 디렉토리에 넣는 이 번거로움에 시달려 왔습니다. 이는 Mainroad, Rodster와 유사한 Hugo 테마를 위한 것입니다.

LLM용으로 두 번째 GPU를 설치할 생각이신가요?

PCIe 랜의 수가 LLM 성능에 미치는 영향? 작업에 따라 다릅니다. 훈련 및 멀티 GPU 추론의 경우 성능 저하가 상당합니다.

AWS S3에 Gitea와 Hugo를 설정한 후...

다음 단계는 CI/CD를 구현하고, Gitea Actions for Hugo website, to push website to AWS S3를 설정하여 master 브랜치가 업데이트될 때 자동으로 웹사이트를 AWS S3에 푸시하는 것입니다.

LLM을 사용하여 HTML에서 텍스트 추출...

Ollama 모델 라이브러리에는 HTML 콘텐츠를 Markdown으로 변환할 수 있는 모델이 포함되어 있습니다. 이는 콘텐츠 변환 작업에 유용합니다. 이 가이드는 우리의 2026년 문서화 도구: Markdown, LaTeX, PDF 및 인쇄 워크플로우 허브의 일부입니다.

Cursor AI vs GitHub Copilot vs Cline AI vs...

여기서 일부 AI 보조 코딩 도구와 AI 코딩 어시스턴트 및 그들의 장점을 나열하겠습니다.

인텔 CPU의 효율성 코어 vs 성능 코어에서의 Ollama

제가 테스트하고 싶은 이론은, 인텔 CPU에서 모든 코어를 사용하면 LLM의 속도가 빨라질까?입니다.

새로운 gemma3 27비트 모델(gemma3:27b, ollama에서 17GB)이 제 GPU의 16GB VRAM에 맞지 않아, 부분적으로 CPU에서 실행되고 있다는 점이 제게 짜증을 주고 있습니다.

유용한 MinIO 명령어

MinIO는 두 가지 표준 UI를 제공합니다: (1) MinIO Console - 이는 웹 UI이며,

(2) MinIO Command - 이는 명령줄 인터페이스입니다 util mc.

개요 및 Minio 설치

MinIO은 아마존 S3 API와 완전히 호환되는 오픈소스, 고성능, 분산형 오브젝트 스토리지 시스템입니다.

AI는 많은 컴퓨팅 파워가 필요합니다...

현대 세계의 혼란 속에서 저는 다른 카드의 기술 사양 비교를 진행하고 있습니다. 이는 AI 작업에 적합한 카드들입니다.

(딥러닝,

객체 감지,

LLMs).

하지만 이 모든 카드는 매우 비싸죠.

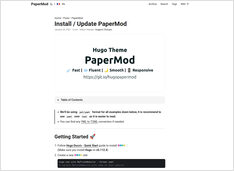

Hugo에서 가장 인기 있는 테마

깃허브에서 Hugo용 최고의 테마 목록을 확인해 보고,

별점 평가를 확인해 보세요.

공식적인 Hugo 테마 목록으로 이동할 수 있습니다: https://themes.gohugo.io/

병렬 요청 실행을 위해 ollama 구성하기.

Ollama 서버가 동일한 시간에 두 개의 요청을 받을 경우, 그 동작은 구성 설정과 사용 가능한 시스템 자원에 따라 달라집니다.

시스템 관리에 대해 조금 알아보기

이제 아마 이 플랫폼 엔지니어링이라고 부르는 것이 더 적절할 것입니다.

How to install connect and remove the Portainer에 대한 몇 가지 노트가 있습니다 - Docker 이미지와 컨테이너 관리 UI.

클라우드에서 빠르게 비동기 작업이 필요한 경우

가끔은 hugo 기반 웹사이트에 폼 제출 기능을 추가해야 할 때가 있습니다.

매주 두 번째 금요일은 아니지만, 여전히… 우리는 두 가지 주요 접근 방식을 가지고 있습니다.

리눅스 서비스로 실행 가능한 실행 파일 실행

다음은 Linux에서 Systemd를 사용하여 실행 가능한 파일을 서비스로 실행하는 방법에 대한 지침입니다.