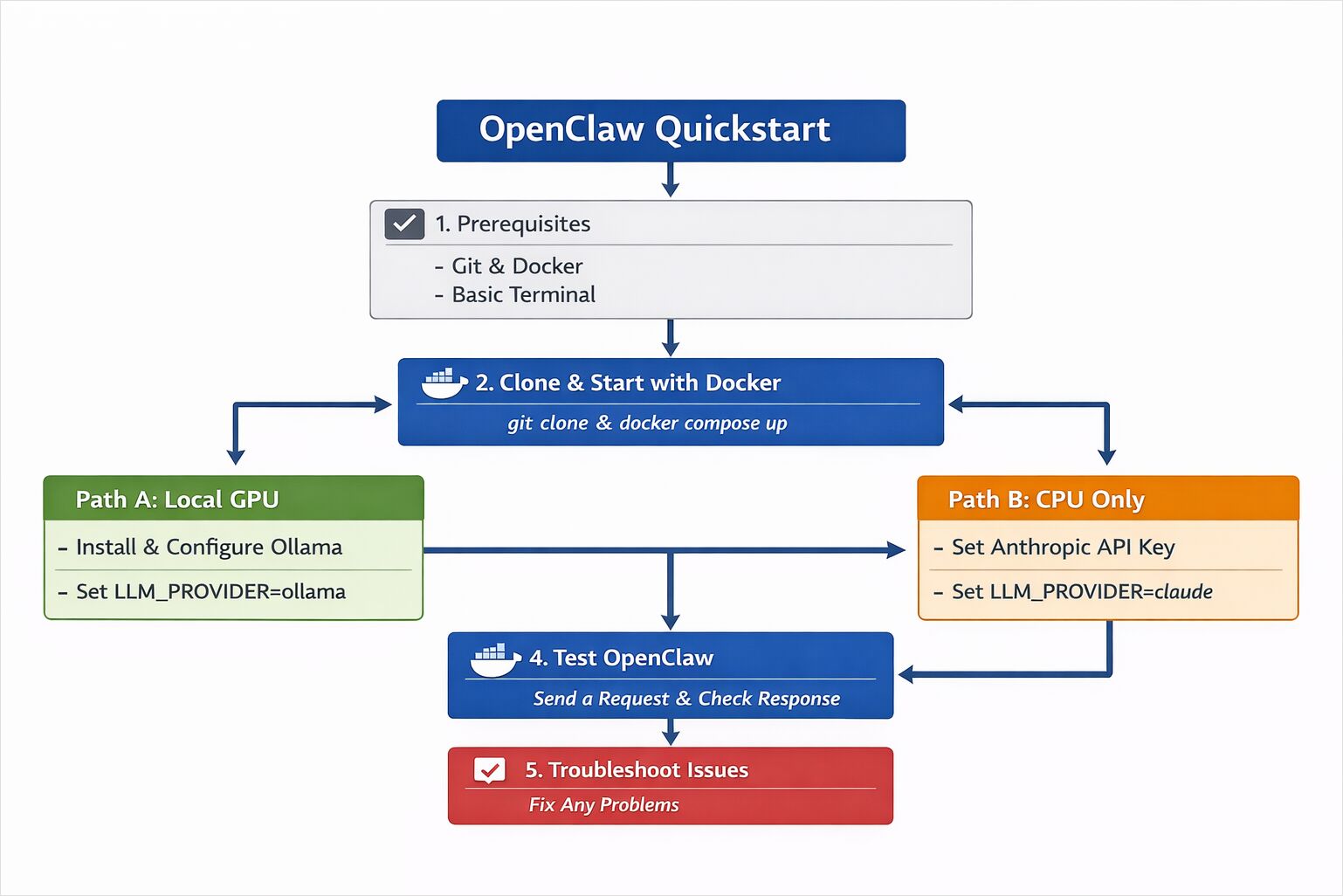

OpenClaw クイックスタート:Docker を使用したインストール(Ollama GPU または Claude + CPU)

Ollama を使用して OpenClaw をローカルにインストールする

OpenClaw は、Ollama などのローカル LLM ランタイム、または Claude Sonnet などのクラウドベースモデルと連携して動作するように設計された、セルフホスト型の AI アシスタントです。

このクイックスタートガイドでは、Docker を使用して OpenClaw をデプロイし、GPU 搭載のローカルモデル、または CPU 専用のクラウドモデルを設定し、AI アシスタントがエンドツーエンドで正常に動作していることを確認する方法を示します。

このガイドでは、OpenClaw の最小限の設定手順を説明し、ご自身のマシン上で動作し、レスポンスを返す状態を確認します。

目標はシンプルです。

- OpenClaw を動作させる

- リクエストを送信する

- 正常に動作することを確認する

これは本番環境での堅牢化ガイドではありません。 パフォーマンスチューニングガイドでもありません。 実用的なスタートポイントです。

2 つの選択肢があります。

- パス A — ローカル GPU: Ollama を使用(GPU がある場合推奨)

- パス B — CPU 専用: Anthropic API を介した Claude Sonnet 4.6 を使用

両方のパスにおいて、基本的なインストールプロセスは共通です。

OpenClaw が初めてで、システムの構造についてより深い概要を知りたい場合は、OpenClaw システム概要 をお読みください。

システム要件と環境設定

OpenClaw は外部サービスに接続できるアシスタント型システムです。このクイックスタートでは以下の点に注意してください。

- 可能な限りテストアカウントを使用する

- 機密性の高い本番システムへの接続は避ける

- Docker 内で実行する(推奨)

エージェント型ソフトウェアを実験する際は、分離(隔離)をデフォルトにすることが推奨されます。

OpenClaw の前提条件(GPU と Ollama、または CPU と Claude)

両方のパスで必要なもの

- Git

- Docker Desktop(または Docker + Docker Compose)

- ターミナル

パス A(ローカル GPU)用

- 互換性のある GPU が搭載されたマシン(NVIDIA または AMD が推奨)

- Ollama のインストール

パス B(CPU + クラウドモデル)用

- Anthropic API キー

- Claude Sonnet 4.6 へのアクセス権

ステップ 1 — Docker を使用して OpenClaw をインストール(クローンと起動)

OpenClaw は Docker Compose を使用して起動できます。これにより、設定が整理され、再現性が高まります。

リポジトリのクローン

git clone https://github.com/openclaw/openclaw.git

cd openclaw

環境設定のコピー

cp .env.example .env

エディタで .env ファイルを開いてください。次のステップで、選択したモデルのパスに応じて設定を行います。

コンテナの起動

docker compose up -d

すべてが正常に起動した場合、コンテナが実行中であることが表示されます。

docker ps

この段階では OpenClaw が動作していますが、まだモデルには接続されていません。

ステップ 2 — LLM プロバイダーの設定(Ollama GPU または Claude CPU)

次に、推論をどのように行いたいかを決定します。

パス A — Ollama を使用したローカル GPU

GPU が利用可能な場合、これが最もシンプルで自己完結型のオプションです。

Ollama のインストールまたは確認

より詳細なインストールガイドが必要な場合、またはモデルの保存場所を設定したい場合は、以下の記事を参照してください。

Ollama がインストールされていない場合:

curl -fsSL https://ollama.com/install.sh | sh

動作を確認します。

ollama pull llama3

ollama run llama3

モデルがレスポンスを返せば、推論機能が正常に動作しています。

OpenClaw の Ollama 利用設定

.env ファイルで以下を設定します。

LLM_PROVIDER=ollama

OLLAMA_BASE_URL=http://host.docker.internal:11434

OLLAMA_MODEL=llama3

コンテナを再起動します。

docker compose restart

これで、OpenClaw はローカルの Ollama インスタンスへリクエストをルーティングします。

16GB の GPU でどのモデルを実行するかを検討している場合、またはベンチマーク比較が必要な場合は、以下の記事を参照してください。

並行処理と負荷下での CPU 動作を理解するために:

パス B — Claude Sonnet 4.6 を使用した CPU 専用

GPU がない場合、ホストされたモデルを使用できます。

API キーの追加

.env ファイルで以下を設定します。

LLM_PROVIDER=anthropic

ANTHROPIC_API_KEY=your_api_key_here

ANTHROPIC_MODEL=claude-sonnet-4-6

再起動します。

docker compose restart

これで、OpenClaw は推論に Claude Sonnet 4.6 を使用し、オーケストレーションはローカルで実行されます。

この設定は CPU 専用マシンでも機能します。重いモデル計算はクラウド上で行われるためです。

ここで Anthropic モデルを使用している場合、この Claude サブスクリプションポリシーの変更 について、OpenClaw が Claude プランの再利用ではなく API ベースの課金が必要となる理由が説明されています。

ステップ 3 — 最初のプロンプトで OpenClaw をテスト

コンテナが実行され、モデルが設定されたら、アシスタントをテストできます。

設定によっては、以下のいずれかを通じてテストできます。

- ウェブインターフェース

- メッセージング統合

- ローカル API エンドポイント

基本的な API テストの場合:

curl http://localhost:3000/health

正常なステータスのレスポンスが表示されるはずです。

次に、シンプルなプロンプトを送信します。

curl -X POST http://localhost:3000/chat -H "Content-Type: application/json" -d '{"message": "Explain what OpenClaw does in simple terms."}'

構造化されたレスポンスが返ってきた場合、システムは正常に動作しています。

実行した内容のまとめ

この時点で、以下の状態が整っています。

- 実行中の OpenClaw インスタンス

- 設定済みの LLM プロバイダー(ローカルまたはクラウド)

- 正常に動作するリクエスト - レスポンスループ

GPU パスをเลือกした場合、推論は Ollama を介してローカルで行われます。

CPU パスを选择了の場合、推論は Claude Sonnet 4.6 を介して行われ、オーケストレーション、ルーティング、メモリ処理はローカルの Docker コンテナ内で実行されます。

見える相互作用はシンプルに見えるかもしれませんが、その背後では複数のコンポーネントが協調してリクエストを処理しています。

OpenClaw のインストールとランタイムの問題のトラブルシューティング

モデルがレスポンスしない場合

.env設定を確認する- コンテナログを確認する:

docker compose logs

Ollama に接続できない場合

- Ollama が実行中であることを確認する:

ollama list

- ベース URL が環境と一致していることを確認する

API キーが無効な場合

ANTHROPIC_API_KEYを再確認する.envを更新した後、コンテナを再起動する

GPU が使用されていない場合

- GPU ドライバーがインストールされていることを確認する

- Docker が GPU アクセスを有効化していることを確認する

OpenClaw インストール後の次のステップ

これで、動作する OpenClaw インスタンスが整いました。

ここから、以下のことができます。

- メッセージングプラットフォームへの接続

- ドキュメント検索の啟用

- ルーティング戦略の実験

- 可観測性とメトリクスの追加

- パフォーマンスとコスト動作のチューニング

システムが動作し始めてからの方が、深いアーキテクチャの議論はより意味をなします。

稼働させることが最初のステップです。

稼働した後、自然な次の記事は以下の通りです。

- OpenClaw プラグインガイド — メモリ、ツール、チャネル、可観測性のためにどのプラグインをインストールすべきか、ライフサイクルの仕組みについて

- OpenClaw スキルガイド — ClawHub からどのスキルをインストールすべきか、エージェントの役割ごとに安全にゲートする方法について

- OpenClaw 本番環境設定パターン — 開発者、自動化チーム、研究者、サポートオペレーターなどの実際のユーザータイプ向けに、プラグインとスキルを組み合わせて信頼性、ワークフロー、スケールを実現するアーキテクチャパターンについて

さらに AI システムの事例については、AI システム セクションを参照してください。