OpenClaw クイックスタート: Docker でインストール (Ollama GPU または Claude CPU)

ローカルに OpenClaw を Ollama でインストールする

OpenClawは、OllamaなどのローカルLLMランタイムや、Claude Sonnetなどのクラウドベースのモデルを使用して動作する、セルフホスト型のAIアシスタントです。

ローカルに OpenClaw を Ollama でインストールする

OpenClawは、OllamaなどのローカルLLMランタイムや、Claude Sonnetなどのクラウドベースのモデルを使用して動作する、セルフホスト型のAIアシスタントです。

セルフホストされたLLMでデータとモデルを制御する

LLMを自社でホストすることで、データ、モデル、推論を自らの管理下に置くことができます。これは、チームや企業、国家にとっても実用的な**AI主権**への道です。

RTX 4080(16GB VRAM)でのLLM速度テスト

大規模言語モデルをローカルで実行すると、プライバシーの確保、オフラインでの使用が可能になり、APIコストはゼロになります。このベンチマークでは、RTX 4080上で動作する14のポピュラーなLLMs on Ollamaから期待できる性能が明らかになります。

2026年1月の人気Goリポジトリ

Goエコシステムは、AIツール、セルフホストアプリケーション、開発者インフラにわたる革新的なプロジェクトとともに、ますます活気づいています。この概要では、今月のGitHub上位トレンドGoリポジトリについて分析します。

ローカルLLM用のセルフホスト型ChatGPT代替ソフトウェア

Open WebUI は、大規模言語モデルと対話するための強力で拡張性があり、機能豊富な自己ホスト型ウェブインターフェースです。

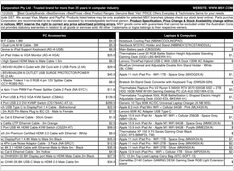

今やオーストラリアの小売業者から実際のAUD価格が提供されています。

NVIDIA DGX Spark (GB10 Grace Blackwell)は オーストラリアで今すぐ購入可能 の主要PC小売店で在庫あり。

グローバルDGX Sparkの価格と入手方法を ご存知の方は、オーストラリアの価格がストレージ構成や小売店によって 6,249〜7,999オーストラリアドル と幅があることをご存知でしょう。

ローカルLLMを使用してCogneeをテストする - 実際の結果

CogneeはPythonフレームワークで、LLMを使用してドキュメントから知識グラフを構築します。 しかし、これはセルフホストされたモデルと互換性がありますか?

BAML と Instructor を使用した型安全な LLM 出力

LLM(大規模言語モデル)を本番環境で使用する際には、構造化された、型安全な出力を得ることが極めて重要です。

BAMLおよびInstructorという2つの人気のあるフレームワークは、この問題に対して異なるアプローチを取ります。

LLMを自社でホストするCogneeについての考察

Best LLM for Cognee を選ぶ際には、グラフ構築の質、幻覚率、ハードウェアの制約のバランスが求められます。

Cognee は、Ollama を介して 32B 以上の低幻覚モデルで優れた性能を発揮しますが、軽量な設定では中規模のオプションも使用可能です。

PythonとOllamaを使ってAI検索エージェントを構築する

OllamaのPythonライブラリは、今やOLlama web searchのネイティブな機能を含んでいます。わずか数行のコードで、ローカルのLLMをインターネット上のリアルタイム情報を補完し、幻覚を減らし、正確性を向上させることができます。

GoとOllamaを使ってAI検索エージェントを構築する

OllamaのWeb検索APIは、ローカルLLMにリアルタイムのウェブ情報を補完する機能を提供します。このガイドでは、GoでのWeb検索の実装について、単純なAPI呼び出しからフル機能の検索エージェントまでの実装方法を示します。

Compare the best local LLM hosting tools in 2026. API maturity, hardware support, tool calling, and real-world use cases.

LLMをローカルで実行することは、開発者、スタートアップ企業、さらには企業チームにとって現在実用的です。

しかし、正しいツールの選択 — Ollama、vLLM、LM Studio、LocalAI またはその他のツール — は、あなたの目的によって異なります:

予算のハードウェアでオープンモデルを使用して企業向けAIを展開

AIの民主化はここにあります。 Llama 3、Mixtral、QwenなどのオープンソースLLMが、今やプロプライエタリモデルと同等の性能を発揮するようになり、チームは消費者ハードウェアを使用して強力なAIインフラストラクチャを構築できるようになりました。これにより、コストを削減しながらも、データプライバシーやデプロイメントに関する完全なコントロールを維持することが可能です。

GPT-OSS 120bの3つのAIプラットフォームにおけるベンチマーク

私は、Ollama上でGPT-OSS 120bのパフォーマンステストを3つの異なるプラットフォームで確認しました:NVIDIA DGX Spark, Mac Studio, and RTX 4080。OllamaライブラリのGPT-OSS 120bモデルは65GBあり、これはRTX 4080(または新しいRTX 5080の16GB VRAMには収まらないことを意味します。