Ollamaモデルを別の場所に移動する

OllamaのLLMモデルファイルは多くのスペースを占めます。

ollamaをインストールした後は、すぐにOllamaを再構成して、新しい場所にモデルを保存するように設定するのが良いでしょう。そうすることで、新しいモデルをプルした際にも、古い場所にダウンロードされません。

Ollamaについて

Ollamaは、LLM AIモデルをテキストベースのフロントエンドとして提供し、それらをホストするAPIも備えています。OllamaとvLLM、Docker Model Runner、LocalAI、クラウドプロバイダーとの比較、コストやインフラのトレードオフについても詳しく知りたい場合は、LLMホスティング: ローカル、セルフホスト、クラウドインフラの比較をご覧ください。

Ollamaのインストール

https://ollama.com/downloadにアクセスしてください。

LinuxでOllamaをインストールするには、以下のコマンドを実行してください:

curl -fsSL https://ollama.com/install.sh | sh

Windows用のOllamaについては、こちらのページをご覧ください: https://ollama.com/download/windows

Mac用のOllamaもこちらにあります: https://ollama.com/download/macOllamaSetup.exe

Ollamaモデルのダウンロード、一覧表示、削除

Ollamaモデルをダウンロードするには、Ollamaライブラリ(https://ollama.com/library)にアクセスし、必要なモデルを探してください。モデルのタグやサイズもここで確認できます。

その後、以下のコマンドを実行してください:

ollama pull gemma2:latest

# もしくは、16GBのVRAMにうまく収まる少し賢いモデルを取得する場合:

ollama pull gemma2:27b-instruct-q3_K_S

# または:

ollama pull llama3.1:latest

ollama pull llama3.1:8b-instruct-q8_0

ollama pull mistral-nemo:12b-instruct-2407-q6_K

ollama pull mistral-small:22b-instruct-2409-q4_0

ollama pull phi3:14b-medium-128k-instruct-q6_K

ollama pull qwen2.5:14b-instruct-q5_0

ローカルリポジトリに保存されているOllamaモデルを確認するには:

ollama list

不要なモデルを削除するには:

ollama rm qwen2:7b-instruct-q8_0 # 例

Ollamaモデルの保存場所

デフォルトでは、モデルファイルは以下に保存されます:

- Windows: C:\Users%username%.ollama\models

- Linux: /usr/share/ollama/.ollama/models

- macOS: ~/.ollama/models

WindowsでOllamaモデルの保存場所を設定する

Windowsで環境変数を作成するには、以下の手順に従ってください:

- Windows設定を開きます。

- 「システム」を選択します。

- 「概要」を選択します。

- 「高度なシステム設定」を選択します。

- 「高度な」タブに移動します。

- 「環境変数…」を選択します。

- 「新規…」をクリックします。

- 「OLLAMA_MODELS」という名前の変数を作成し、モデルを保存したい場所を指定します。

LinuxでOllamaモデルを移動する

ollamaのsystemdサービスパラメータを編集します。

sudo systemctl edit ollama.service

または

sudo xed /etc/systemd/system/ollama.service

これによりエディタが開きます。

各環境変数に対して、[Service]セクションにEnvironment行を追加します。

[Service]

Environment="OLLAMA_MODELS=/specialplace/ollama/models"

保存して終了します。

UserとGroupのパラメータも存在しており、これらのユーザーとグループはこのフォルダにアクセスできる必要があります。

systemdを再読み込みし、Ollamaを再起動します:

sudo systemctl daemon-reload

sudo systemctl restart ollama

何か問題が起きた場合は:

systemctl status ollama.service

sudo journalctl -u ollama.service

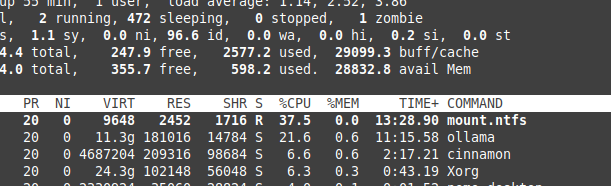

NTFSフォーマットのオーバーヘッド

Linuxで動作させている場合、モデルをNTFSフォーマットのパーティションに保存していると、モデルの読み込み速度が20%以上遅くなる可能性があります。

WindowsにOllamaを特定のフォルダにインストールする

モデルとともに

.\OllamaSetup.exe /DIR=D:\OllamaDir

内部ネットワークにOllama APIを公開する

ここでの「内部」はローカルネットワークを指します。

サービス構成に以下を追加してください:

[Service]

Environment="OLLAMA_HOST=0.0.0.0"

Ollamaが他のローカルおよびクラウドLLMオプションとどのように統合されるかについては、LLMホスティング: ローカル、セルフホスト、クラウドインフラの比較をご覧ください。