NVIDIA GPUのAI適性比較

AIは多くのパワーが必要です…

目次

現代の世界の混乱の中でも、ここではさまざまなカードのテクスペックを比較、AIタスクに適したAI用のカードについて見ていく。

(Deep Learning、

Object Detection、

およびLLMs)。

しかし、これらはすべて非常に高価です。

GPUの選択がLLMのスループット、VRAMの制限、および実行環境にわたるベンチマークに与える影響についてさらに詳しく知りたい場合は、LLMパフォーマンス: ベンチマーク、ボトルネック & 最適化を参照してください。

これはAIによって生成された画像です。本気で受け止める必要はありません…

他のオプションも見てみましょう

| カード | VRAM | バス幅 | メモリ帯域幅 | CUDAコア数 | Tensorコア数 | 電力消費 (W) |

|---|---|---|---|---|---|---|

| RTX 4060 Ti 16GB | 16 GB | 128-bit | 288 GB/s | 4,352 | 136 | 165 |

| RTX 4070 Ti 16GB | 16 GB | 256-bit | 672 GB/s | 7,680 | 240 | 285 |

| RTX 4080 16GB | 16 GB | 256-bit | 716.8 GB/s | 9,728 | 304 | 320 |

| RTX 4080 Super 16GB | 16 GB | 256-bit | 736 GB/s | 10,240 | 320 | 320 |

| RTX 4090 24GB | 24 GB | 384-bit | 1008 GB/s | 16,384 | 512 | 450 |

| RTX 5060 Ti 16GB | 16 GB | 128-bit | 448 GB/s | 4,608 | 144 | 180 |

| RTX 5070 Ti 16GB | 16 GB | 256-bit | 896 GB/s | 8,960 | 280 | 300 |

| RTX 5080 16GB | 16 GB | 256-bit | 896 GB/s | 10,752 | 336 | ~320 |

| RTX 5090 32GB | 32 GB | 512-bit | 1792 GB/s | 21,760 | 680 | ~450 |

| RTX 2000 Ada | 16 GB | 128-bit | 224 GB/s | 2,816 | 88 | 70 |

| RTX 4000 Ada | 20 GB | 160-bit | 280 GB/s | 6,144 | 192 | 70 |

| RTX 4500 Ada | 24 GB | 192-bit | 432 GB/s | 7,680 | 240 | 210 |

| RTX 5000 Ada | 32 GB | 256-bit | 576 GB/s | 12,800 | 400 | 250 |

| RTX 6000 Ada | 48 GB | 384-bit | 960 GB/s | 18,176 | 568 | 300 |

メモリ帯域幅:

- RTX 5090 (1792 GB/s)、次にRTX 4090 (1008 GB/s)、次にRTX 6000 Ada (960 GB/s)

Tensorコア:

- RTX 5090 (680)、次にRTX 6000 Ada (568)、次にRTX 4090 (512)

CUDAコア:

- RTX 5090 (21,760)、次にRTX 6000 Ada (18,176)、次にRTX 4090 (16,384)

RAM:

- RTX 6000 Ada (48 GB)、次にRTX 5090およびRTX 5000 Ada (32 GB)、次にRTX 4090 (24 GB)

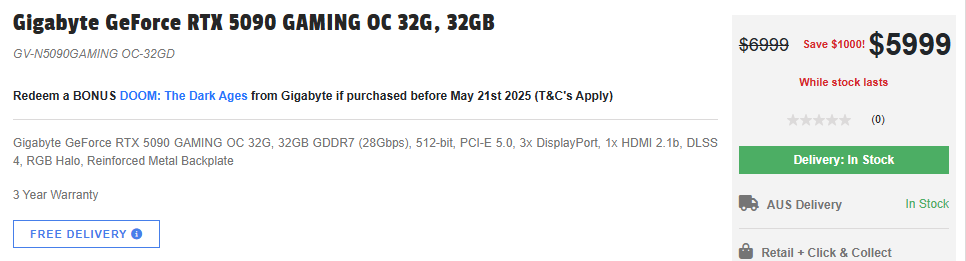

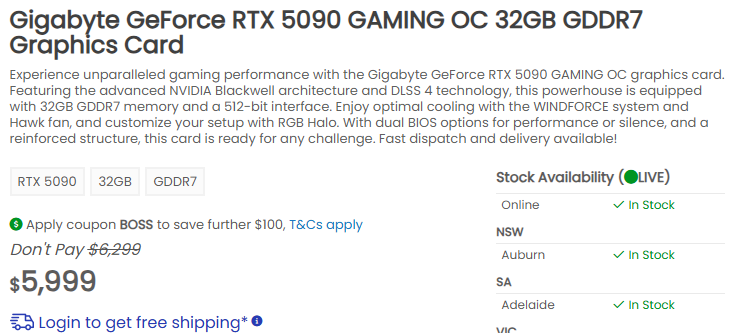

オーストラリアでの価格

- RTX 6000 Ada: 12,000 AUD

- RTX 5090: 6,000 AUD

- RTX 5000 Ada: 7,000 AUD

- RTX 4090: 在庫なし

LLM用の最適な消費者向けGPU

それでも私は、RTX 5090が機械学習、ディープラーニング、AI、さらにはLLMにとって最適な選択肢であると考えています。

実際の価格

少し高価です…

実際のRTX 5090の価格は予想より50%も高くなっています。こちらをご覧ください!

これは2025年5月15日に掲載されたものです。

LLMのベンチマーク、VRAMの要件、およびさまざまなGPUと実行環境でのパフォーマンス調整について詳しく知りたい場合は、LLMパフォーマンス: ベンチマーク、ボトルネック & 最適化ハブをご覧ください。