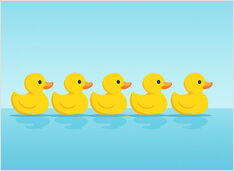

FLUX.1-Kontext-dev: KI-Modell zur Bildvergrößerung

KI-Modell zur Erweiterung von Bildern mit Textanweisungen

Black Forest Labs hat FLUX.1-Kontext-dev veröffentlicht, ein fortschrittliches Bild-zu-Bild-KI-Modell, das bestehende Bilder mithilfe von Textanweisungen erweitert.