AWS Kinesis を使用したイベント駆動型マイクロサービスの構築

スケーラビリティに優れたAWS Kinesisを活用したイベント駆動型アーキテクチャ

AWS Kinesis は、現代のイベント駆動型マイクロサービスアーキテクチャを構築するための基盤として、最小限の運用負荷で大規模なリアルタイムデータ処理を可能にしています。

スケーラビリティに優れたAWS Kinesisを活用したイベント駆動型アーキテクチャ

AWS Kinesis は、現代のイベント駆動型マイクロサービスアーキテクチャを構築するための基盤として、最小限の運用負荷で大規模なリアルタイムデータ処理を可能にしています。

GraphQL BFF と Apollo Server を使用してフロントエンド API を最適化する

Backend for Frontend (BFF) パターンをGraphQLとApollo Serverと組み合わせることで、現代のウェブアプリケーションに強力なアーキテクチャを構築できます。

自社ホスティング可能なNextcloudクラウドストレージでデータをコントロールしましょう

Nextcloud は、データを完全に自身のコントロール下に置くことができる、オープンソースで自己ホスティング可能なクラウドストレージおよび協働プラットフォームのリーディングカンパニーです。

2つの強力な知識管理システム

正しいパーソナル・ノウハウ・マネジメント(PKM)ツールの選択は、あなたの生産性、学習、情報整理に大きな影響を与えることができます。では、ObsidianとLogSeqを見てみましょう。

ご自身でホストするAIを活用したバックアップに使用される写真

Immich は、あなたの思い出を完全にコントロールできる、革新的なオープンソースでセルフホスト型の写真および動画管理ソリューションです。Google Photos と競合する機能を備えており、AI による顔認識、スマート検索、自動モバイルバックアップを含みながら、あなたのデータをプライバシーとセキュリティを保ったまま、あなたのサーバー上に保管します。

検索、インデクシングおよび分析用のElasticsearchコマンド

Elasticsearch は、Apache Lucene に基づいて構築された強力な分散型検索および分析エンジンです。 この包括的なチートシートでは、Elasticsearch クラスターを使用する際の必須コマンド、ベストプラクティス、およびクイックリファレンスをカバーしています。

GPT-OSS 120bの3つのAIプラットフォームにおけるベンチマーク

私は、Ollama上でGPT-OSS 120bのパフォーマンステストを3つの異なるプラットフォームで確認しました:NVIDIA DGX Spark, Mac Studio, and RTX 4080。OllamaライブラリのGPT-OSS 120bモデルは65GBあり、これはRTX 4080(または新しいRTX 5080の16GB VRAMには収まらないことを意味します。

pytest を用いた Python のテスト、TDD、モック、およびカバレッジ

ユニットテストは、Pythonコードが正しく動作し、プロジェクトが進化してもその動作が維持されることを保証します。 この包括的なガイドでは、Pythonでのユニットテストについて知っておくべきすべての内容をカバーしており、基本的な概念から高度な技術まで説明しています。

Pythonの例を使ってAIアシスタント用のMCPサーバーを構築する

モデルコンテキストプロトコル(MCP)は、AIアシスタントが外部データソースやツールとどのように相互作用するかを革命的に変えてきました。本ガイドでは、ウェブ検索およびスクレイピング機能に焦点を当てた例を用いて、MCPサーバーをPythonで構築する方法について説明します。

Ubuntu キーボードショートカット -> あなたの生産性

Ubuntuのキーボードショートカットは、生産性と効率を最大化するための重要なツールです。開発者、システム管理者、またはパワーユーザーであっても、これらのショートカットは作業フローをスピードアップし、マウスへの依存を減らすことができます。

HTMLをクリーンでLLM対応のMarkdownに変換するためのPython

HTMLをMarkdownに変換は、LLM(大規模言語モデル)やドキュメンテーションシステム、Hugoなどの静的サイトジェネレーター向けのウェブコンテンツ準備において、現代の開発ワークフローにおいて基本的なタスクです。このガイドは、2026年のドキュメンテーションツール: Markdown、LaTeX、PDFおよび印刷ワークフロー ハブの一部です。

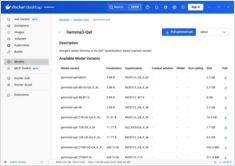

Docker Model Runner コマンドのクイックリファレンス

Docker Model Runner (DMR) は、2025年4月に導入された Docker の公式ソリューションで、AIモデルをローカルで実行するためのものです。このチートシートでは、すべての必須コマンド、構成、およびベストプラクティスのクイックリファレンスを提供しています。

Docker Model RunnerとOllamaを比較してみる:ローカルLLM向け

ローカルで大規模言語モデル(LLM)を実行する は、プライバシー、コスト管理、オフライン機能のためにますます人気になってきています。 2025年4月にDockerが**Docker Model Runner (DMR)**を導入し、AIモデルの展開用の公式ソリューションとして登場したことで、状況は大きく変わりました。

本格的なサービスメッシュの展開 - Istio と Linkerd の比較

Istio および Linkerd を使用してサービスメッシュアーキテクチャを実装および最適化する方法を確認してください。このガイドでは、展開戦略、パフォーマンス比較、セキュリティ構成、および生産環境でのベストプラクティスについて説明します。

GNOME Boxes による Linux 用のシンプルな仮想マシン管理

現代のコンピューティング環境において、仮想化は開発、テスト、複数のオペレーティングシステムの実行において不可欠となっています。Linuxユーザーが仮想マシンを簡単に管理できる方法を探している場合、GNOME Boxesは、機能性を犠牲にすることなく、軽量で使いやすいオプションとして際立っています。

21,000人以上のユーザーを持つ分散型ソーシャルプロトコルでオンラインプライバシーを再定義する

ここにNostrがあります - 感情のない通信とユーザー所有のデータを備えた、大手企業の支配に挑戦する分散型ソーシャルプロトコル。