LLMの性能とPCIeレーン:主要な考慮点

LLM用に2番目のGPUをインストールすることを考慮していますか?

PCIe レーンがLLM性能に与える影響? タスクによります。トレーニングやマルチGPUの推論では、パフォーマンスの低下が顕著です。

LLM用に2番目のGPUをインストールすることを考慮していますか?

PCIe レーンがLLM性能に与える影響? タスクによります。トレーニングやマルチGPUの推論では、パフォーマンスの低下が顕著です。

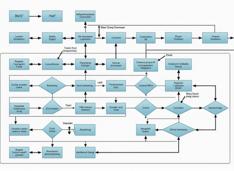

AWS S3 上で Gitea と Hugo を設定した後...

次のステップは、CI/CDを実装し、Gitea Actions for Hugo website, to push website to AWS S3を設定することです。masterブランチが更新されたときに自動的にウェブサイトをAWS S3にプッシュします。

LLMでHTMLからテキストを抽出する...

Ollama モデルライブラリには、HTML コンテンツを Markdown に変換できるモデルが存在します。これはコンテンツ変換タスクに役立ちます。このガイドは、2026年のドキュメンテーションツール: Markdown、LaTeX、PDFおよび印刷ワークフロー ハブの一部です。

カーソルAI vs ジョイブコパイロット vs クラインAI vs...

いくつかのAI支援によるコーディングツールおよびAIコーディングアシスタントとその魅力的な特徴について紹介します。

インテルCPUにおけるOllamaの効率的なコアとパフォーマンスコアの比較

私はある仮説をテストしたいと思っています。すなわち、「インテルCPUのすべてのコアを活用することで、LLMの速度が向上するか?」というものです。このテストについては、ALL cores on Intel CPU would raise the speed of LLMs?をご覧ください。

新しいgemma3 27bitモデル(gemma3:27b、ollama上では17GB)が私のGPUの16GB VRAMに収まらず、部分的にCPU上での実行に頼っているという点が気になります。

役に立つ MinIO コマンド

MinIOは2つの標準的なUIを提供しています:(1) MinIO Console - これはウェブUIです、および (2) MinIO Command - これはコマンドライン util mc。

概要とMinioのインストール

MinIO は、Amazon S3 API と完全に互換性のあるオープンソースで、高性能な分散型オブジェクトストレージシステムです。

AIは多くのパワーが必要です…

現代の世界の混乱の中でも、ここではさまざまなカードのテクスペックを比較、AIタスクに適したAI用のカードについて見ていく。

(Deep Learning、

Object Detection、

およびLLMs)。

しかし、これらはすべて非常に高価です。

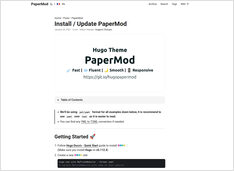

Hugoで人気のあるテーマ

GitHubでHugo用の最高のテーマ一覧を確認し、スター数をチェックしてみましょう。

公式のHugoテーマ一覧ページにアクセスできます: https://themes.gohugo.io/

オラマを並列リクエストの実行に設定する。

Ollama サーバーが同時に2つのリクエストを受け取った場合、その動作は設定と利用可能なシステムリソースに依存します。

システム管理のちょっとした話

おそらく、このプラットフォームエンジニアリングと呼ぶべきかもしれません。 以下は、LinuxでConnectをインストールし、Portainerを削除する方法に関するいくつかのメモです。DockerイメージとコンテナのマネージャーUIです。

クラウドで迅速に非同期処理が必要なとき

時折、Hugoベースのウェブサイトにフォームの送信機能を追加する必要があります。

毎月の第2金曜日ではなくても、それでも…

Linux サービスとして任意の実行ファイルを実行する

以下は、Linuxで任意の実行可能ファイルをサービスとして実行する方法に関する指示です。Systemdを使用して任意の実行可能ファイルをサービスとして実行する方法。

2つのdeepseek-r1モデルを2つのベースモデルと比較する

DeepSeekの 1世代目の推論モデルで、OpenAI-o1と同等の性能を備えています。 これは、LlamaおよびQwenに基づいてDeepSeek-R1から蒸留された6つの密結合モデルです。

一部のPOSSEの概念と例