比較: Qwen3:30b と GPT-OSS:20b

これらの2つのモデルの速度、パラメータ、および性能の比較

ここに Qwen3:30b と GPT-OSS:20b の比較を示します。指示の遵守とパフォーマンスのパラメータ、仕様、速度に焦点を当てています。

これらの2つのモデルの速度、パラメータ、および性能の比較

ここに Qwen3:30b と GPT-OSS:20b の比較を示します。指示の遵守とパフォーマンスのパラメータ、仕様、速度に焦点を当てています。

ホスティングコストの概算とサブスクリプションの比較。

以下は、提供されたHugoページコンテンツの日本語への翻訳です。すべてのHugoショートコード、技術要素、構造を維持しつつ、日本語の文法、文体、表記規則に従って翻訳を行いました。

Write.as / WriteFreelyに関する簡単な情報 – どのようにfediverseに適合するか、管理ホスティングの入手先、使用傾向、およびセルフホスト方法(コストの概算も含む)について。

+ 思考型LLMを使用した具体的な例

この投稿では、PythonアプリケーションをOllamaに接続する2つの方法について紹介します。1つ目はHTTP REST APIを使用する方法、2つ目は公式のOllama Pythonライブラリを使用する方法です。

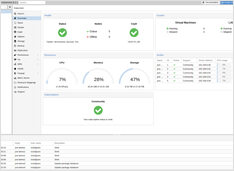

プロクシマックスとは何か?

Proxmox Virtual Environment (Proxmox VE) は、Debian 上に構築されたオープンソースのタイプ1ハイパバーリザーバーおよびデータセンターのオーケストレーションプラットフォームです。

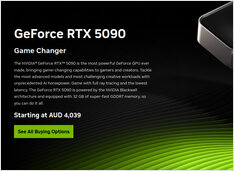

AI 向けコンシューマー GPU の価格 – RTX 5080 と RTX 5090

LLM や AI 一般に特に適した、トップクラスの消費向け GPU の価格を比較してみましょう。 具体的には、RTX-5080 と RTX-5090 の価格 を見ていきます。 価格はわずかに下落しています。

あまり良くない。

OllamaのGPT-OSSモデルは、LangChainやOpenAI SDK、vllmなどのフレームワークと使用する際に、構造化された出力を処理する際に繰り返し問題が発生しています。

Ollamaから構造化された出力を得るいくつかの方法

大規模言語モデル(LLM) は強力ですが、実運用では自由な形式の段落はほとんど使いません。 代わりに、予測可能なデータ:属性、事実、またはアプリにフィードできる構造化されたオブジェクトを望みます。 それはLLM構造化出力です。

Kubuntu と KDE Neon の両方を試しましたが、Kubuntu の方が安定しています。

KDE Plasma ファンにとって、議論の俎上に上がるLinuxディストリビューションは主に2つあります: Kubuntu と KDE Neon。 これらは似ているように見えます。どちらもデフォルトでKDE Plasmaを提供し、Ubuntuをベースにしており、初心者にも優しいからです。

オラマモデルのスケジューリングに関する自分のテスト

ここでは、新しいバージョンのOllamaがモデルに対してどのくらいのVRAMを割り当てているかについて、Ollama VRAM割り当てと以前のOllamaバージョンを比較しています。新しいバージョンは、以前のバージョンよりも劣っています。

Linuxで静的IPを設定する際の注意点

このガイドでは、Ubuntu サーバーでの静的IPアドレスの変更の手順をステップバイステップで説明します。

現在のOllama開発状況に対する私の見解

Ollama は、LLM をローカルで実行するためのツールとして、非常に人気のあるツールの一つとなっています。

シンプルな CLI と、モデル管理の簡素化により、クラウド外で AI モデルと仕事をしたい開発者にとっての定番のオプションとなっています。

代替のVoIP通信プラットフォーム

Mumble は、主にリアルタイムの音声通話を目的とした、無料でオープンソースのVoIP(Voice over IP)アプリケーションです。クライアント-サーバーのアーキテクチャを使用しており、ユーザーは共有サーバーに接続してお互いに話すことができます。

2025年のOllamaで最も注目されているUIの概要

ローカルにホストされた Ollama は、あなたのマシン上で大規模言語モデルを実行できるが、コマンドライン経由での使用はユーザーにとって使いにくい。

以下に、ローカルの Ollama に接続するための、いくつかのオープンソースプロジェクトが提供する ChatGPTスタイルのインターフェース がある。

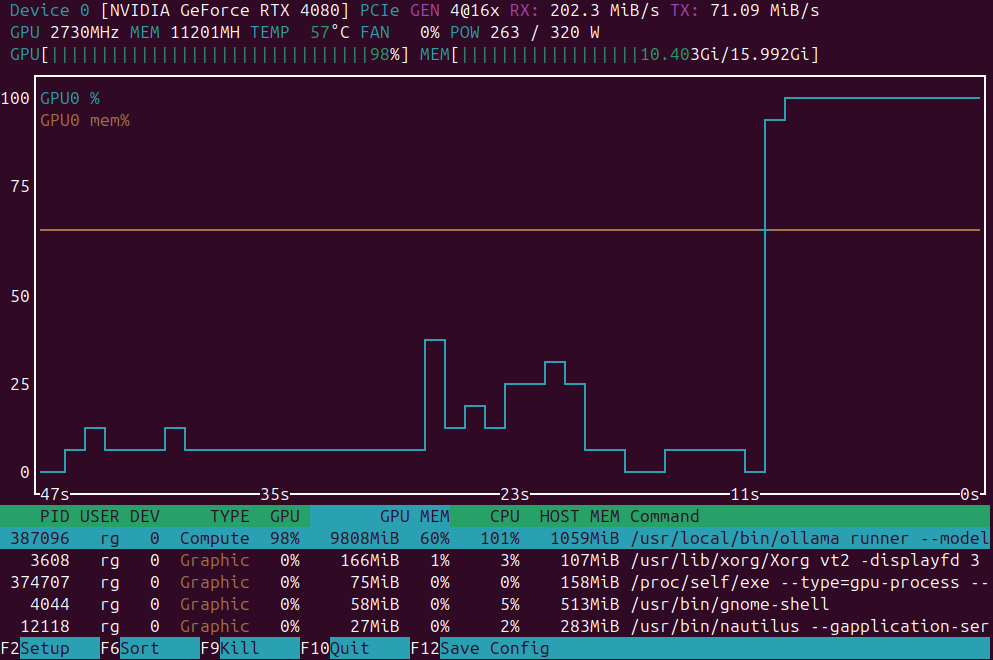

GPU負荷監視用のアプリケーションの簡単な一覧

GPU負荷監視アプリケーション: nvidia-smi vs nvtop vs nvitop vs KDE plasma systemmonitor.

ホームラボクラスターにlittle k3s Kubernetesをインストールする

以下は、提供されたHugoページの英語から日本語への翻訳です。すべての技術的なフォーマット、構造、Hugo固有の要素は維持されています。

ここでは、裸の金属サーバー(1マスター + 2ワーカー)上で**3ノードK3sクラスターのインストール**を行うステップバイステップのガイドを紹介します。

Kubernetesのバリエーションの簡単な概要

自己ホスティング可能な Kubernetes の配布版を比較し、裸金属やホームサーバーでのホスティングに焦点を当て、インストールの容易さ、パフォーマンス、システム要件、機能セットを比較します。