AWS CLI を使用して Hugo サイトを AWS S3 にデプロイする

AWS S3 への Hugo のデプロイを自動化する

AWS CLIを使用してHugo静的サイトをAWS S3にデプロイすることで、ウェブサイトをホストするための堅牢でスケーラブルなソリューションが提供されます。このガイドでは、初期設定から高度な自動化およびキャッシュ管理戦略まで、完全なデプロイメントプロセスをカバーしています。

AWS S3 への Hugo のデプロイを自動化する

AWS CLIを使用してHugo静的サイトをAWS S3にデプロイすることで、ウェブサイトをホストするための堅牢でスケーラブルなソリューションが提供されます。このガイドでは、初期設定から高度な自動化およびキャッシュ管理戦略まで、完全なデプロイメントプロセスをカバーしています。

ハーグоサイトの開発と運用を最適化する

Hugoのキャッシュ戦略は、静的サイトジェネレータのパフォーマンスを最大化するために不可欠です。Hugoは本来静的なファイルを生成するため、処理が高速ですが、複数のレイヤーで適切なキャッシュを実装することで、ビルド時間の大幅な改善、サーバー負荷の軽減、ユーザー体験の向上が可能です。

専用チップにより、AIの推論がより高速かつ低コストになってきている。

ステップバイステップの例

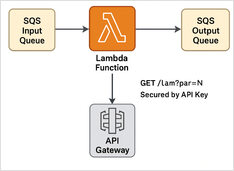

ここに、Python LambdaのSQSメッセージプロセッサの例 + REST APIとAPIキー保護 + Terraformスクリプトがあり、サーバーレス実行のためにそれをデプロイします。

ホスティングコストの概算とサブスクリプションの比較。

以下は、提供されたHugoページコンテンツの日本語への翻訳です。すべてのHugoショートコード、技術要素、構造を維持しつつ、日本語の文法、文体、表記規則に従って翻訳を行いました。

Write.as / WriteFreelyに関する簡単な情報 – どのようにfediverseに適合するか、管理ホスティングの入手先、使用傾向、およびセルフホスト方法(コストの概算も含む)について。

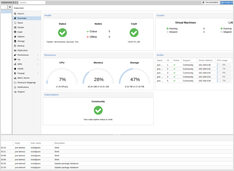

プロクシマックスとは何か?

Proxmox Virtual Environment (Proxmox VE) は、Debian 上に構築されたオープンソースのタイプ1ハイパバーリザーバーおよびデータセンターのオーケストレーションプラットフォームです。

AWSプラットフォームエンジニアリングに適した優れたツールです

AWS Cloud Development Kit (AWS CDK)

は、TypeScriptやPython、Java、Goなどの馴染みのあるプログラミング言語を使ってクラウドインフラストラクチャを定義し、プロビジョニングできるフレームワークです。

TypeScript、

Python、Javaおよび

Go

家庭用ラボ用に最適なKubernetesのバージョンを選ぶ

私は、Ubuntuベースのホームラボで3ノード(16GB RAM、各4コア)に適した、インストールとメンテナンスが簡単で、永続ボリュームとロードバランサーをサポートする自己ホスト型Kubernetesのバリエーションを比較しています。

GitHub Actions の一般的な構造について少し説明します。

GitHub Actions

は、プッシュ、プルリクエスト、またはスケジュールなどのイベントに基づいてコードを構築、テスト、デプロイするためのGitHub内での自動化およびCI/CDプラットフォームです。

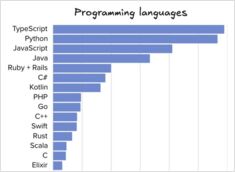

ソフトウェアエンジニアリングツールおよび言語の比較

The Pragmatic Engineerのレターは数日前に、2025年中盤におけるプログラミング言語、IDE、AIツールの普及状況などのデータを掲載しました。

すべての Terraform コマンドのリスト

ここに、Terraformのチートシートがあります。これは、必須のコマンド、構成要素、リソース管理、モジュール、変数、ステートの処理、およびベストプラクティスが含まれています。

GitOpsに関するいくつかのノート

GitOps は、Git を唯一の真実の情報源として、インフラストラクチャおよびアプリケーションのデプロイメントを管理する現代的なアプローチです。Git のバージョン管理機能を活用して、アプリケーションおよびインフラストラクチャのデプロイメントおよび管理のプロセスを自動化し、特にクラウドネイティブ環境において効率化します。

Dockerコンテナを使用してFlutter Webアプリを構築およびホストする

いくつかの例として、DockerfileでFlutterウェブアプリの構築とホスティング、UbuntuベースのFlutterビルドイメージ+ウェブアプリイメージをNginxでホストする方法があります。

AWS S3 上で Gitea と Hugo を設定した後...

次のステップは、CI/CDを実装し、Gitea Actions for Hugo website, to push website to AWS S3を設定することです。masterブランチが更新されたときに自動的にウェブサイトをAWS S3にプッシュします。

概要とMinioのインストール

MinIO は、Amazon S3 API と完全に互換性のあるオープンソースで、高性能な分散型オブジェクトストレージシステムです。

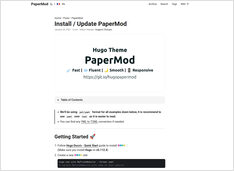

Hugoで人気のあるテーマ

GitHubでHugo用の最高のテーマ一覧を確認し、スター数をチェックしてみましょう。

公式のHugoテーマ一覧ページにアクセスできます: https://themes.gohugo.io/