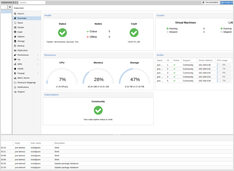

2025年のProxmox: 実用的で統合型の仮想化スタック

プロクシマックスとは何か?

Proxmox Virtual Environment (Proxmox VE) は、Debian 上に構築されたオープンソースのタイプ1ハイパバーリザーバーおよびデータセンターのオーケストレーションプラットフォームです。

プロクシマックスとは何か?

Proxmox Virtual Environment (Proxmox VE) は、Debian 上に構築されたオープンソースのタイプ1ハイパバーリザーバーおよびデータセンターのオーケストレーションプラットフォームです。

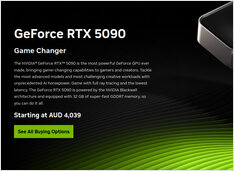

AIに最適な消費者向けGPUの価格 - RTX 5080およびRTX 5090

またまた、LLM(大規模言語モデル)に特に、AI全般に適した上位レベルの消費者向けGPUの価格を比較してみましょう。具体的には、以下を確認しています。

RTX-5080およびRTX-5090の価格

価格はわずかに下がっています。

あまり良くない。

OllamaのGPT-OSSモデルは、LangChainやOpenAI SDK、vllmなどのフレームワークと使用する際に、構造化された出力を処理する際に繰り返し問題が発生しています。

Ollamaから構造化された出力を得るいくつかの方法

大規模言語モデル(LLM) は強力ですが、実運用では自由な形式の段落はほとんど使いません。 代わりに、予測可能なデータ:属性、事実、またはアプリにフィードできる構造化されたオブジェクトを望みます。 それはLLM構造化出力です。

Kubuntu と KDE Neon の両方を試してみたが、Kubuntu のほうがより安定している。

KDE Plasmaファンにとって、2つのLinuxディストリビューションがよく議論の対象になります:

Kubuntu と KDE Neon。

どちらも似ているように見えるかもしれません。どちらもKDE Plasmaをデフォルトのデスクトップとして搭載し、どちらもUbuntuをベースにし、どちらも新規ユーザーに親しみやすいです。

オラマモデルのスケジューリングに関する自分のテスト

ここでは、新しいバージョンのOllamaがモデルに対してどのくらいのVRAMを割り当てているかについて、Ollama VRAM割り当てと以前のOllamaバージョンを比較しています。新しいバージョンは、以前のバージョンよりも劣っています。

Linuxで静的IPを設定する際の注意点

このガイドでは、Ubuntu サーバーでの静的IPアドレスの変更の手順をステップバイステップで説明します。

現在のOllama開発状況に対する私の見解

Ollama は、LLM をローカルで実行するためのツールとして、非常に人気のあるツールの一つとなっています。

シンプルな CLI と、モデル管理の簡素化により、クラウド外で AI モデルと仕事をしたい開発者にとっての定番のオプションとなっています。

代替のVoIP通信プラットフォーム

Mumble は、主にリアルタイムの音声通話を目的とした、無料でオープンソースのVoIP(Voice over IP)アプリケーションです。クライアント-サーバーのアーキテクチャを使用しており、ユーザーは共有サーバーに接続してお互いに話すことができます。

2025年のOllamaで最も注目されているUIの概要

ローカルにホストされた Ollama は、あなたのマシン上で大規模言語モデルを実行できるが、コマンドライン経由での使用はユーザーにとって使いにくい。

以下に、ローカルの Ollama に接続するための、いくつかのオープンソースプロジェクトが提供する ChatGPTスタイルのインターフェース がある。

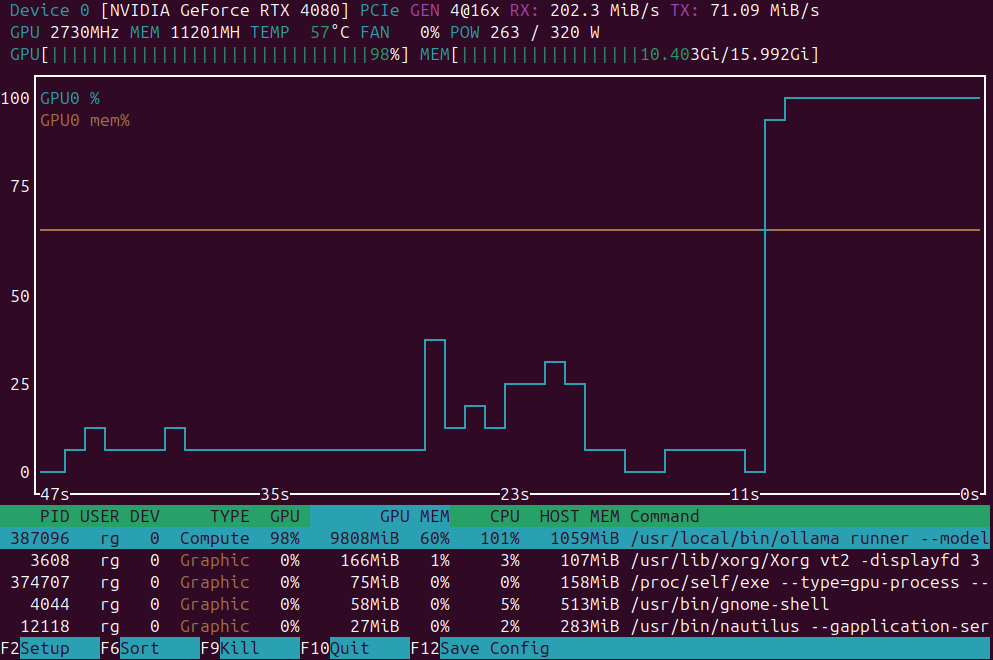

GPU負荷監視用のアプリケーションの簡単な一覧

GPU負荷監視アプリケーション: nvidia-smi vs nvtop vs nvitop vs KDE plasma systemmonitor.

ホームラボクラスターにlittle k3s Kubernetesをインストールする

以下は、提供されたHugoページの英語から日本語への翻訳です。すべての技術的なフォーマット、構造、Hugo固有の要素は維持されています。

ここでは、裸の金属サーバー(1マスター + 2ワーカー)上で**3ノードK3sクラスターのインストール**を行うステップバイステップのガイドを紹介します。

Kubernetesのバリエーションの簡単な概要

自己ホスティング可能な Kubernetes の配布版を比較し、裸金属やホームサーバーでのホスティングに焦点を当て、インストールの容易さ、パフォーマンス、システム要件、機能セットを比較します。

家庭用ラボ用に最適なKubernetesのバージョンを選ぶ

私は、Ubuntuベースのホームラボで3ノード(16GB RAM、各4コア)に適した、インストールとメンテナンスが簡単で、永続ボリュームとロードバランサーをサポートする自己ホスト型Kubernetesのバリエーションを比較しています。

GitHub Actions の一般的な構造について少し説明します。

GitHub Actions

は、プッシュ、プルリクエスト、またはスケジュールなどのイベントに基づいてコードを構築、テスト、デプロイするためのGitHub内での自動化およびCI/CDプラットフォームです。

ちなみに、docker-compose は docker compose とは異なります…

以下は、Docker Composeに関するヒントと例を含む、日本語に翻訳されたHugoページのコンテンツです。

Docker Compose チートシート

注釈付きの例を用いて、Composeファイルとコマンドを素早くマスターするのに役立ちます。